Mujer detenida cinco meses por error de inteligencia artificial en reconocimiento facial

Una mujer estadounidense de 50 años permaneció encarcelada durante más de cinco meses después de que un sistema de reconocimiento facial impulsado por inteligencia artificial la identificara incorrectamente como responsable de presuntos delitos cometidos en Dakota del Norte, un estado donde ella afirma no haber puesto un pie en su vida.

Detención a más de 1.600 kilómetros de distancia

Según información revelada por la cadena CNN, Angela Lipps fue detenida en Tennessee el 14 de julio pasado, sin tener conocimiento de que semanas antes se había emitido una orden de captura en su contra desde Fargo, Dakota del Norte, a más de 1.600 kilómetros de su domicilio. Los cargos estaban relacionados con un presunto fraude bancario que la policía local investigaba.

El jefe del Departamento de Policía de Fargo, Dave Zibolski, explicó mediante correo electrónico que los investigadores utilizaron la tecnología de reconocimiento facial Clearview AI, que funciona como una base de datos masiva con miles de millones de fotografías recopiladas de Internet, incluidas plataformas de redes sociales.

El sistema identificó "rasgos similares"

En un comunicado oficial, la policía detalló que Clearview AI "identificó a una posible sospechosa con rasgos similares a los de Angela Lipps", información que fue compartida entre los departamentos de policía de West Fargo y Fargo. Esta identificación errónea desencadenó todo el proceso legal que llevó a su detención.

La mujer pasó inicialmente más de tres meses en una cárcel de Tennessee antes de ser extraditada a Dakota del Norte, donde continuó su encarcelamiento. No fue hasta el 12 de diciembre que la Fiscalía del Estado informó al detective de Fargo sobre la presentación de "posibles pruebas exculpatorias" por parte de la defensa.

Desestimación de cargos y reconocimiento de errores

El 23 de diciembre, el detective de Fargo, el fiscal del estado y el juez "acordaron de mutuo acuerdo desestimar los cargos sin perjuicio para permitir que se siguiera investigando", según confirmó la policía local. Zibolski reconoció en una rueda de prensa realizada el martes pasado "algunos errores" en el manejo del caso y afirmó que desde entonces la herramienta de inteligencia artificial había sido prohibida, aunque no ofreció una disculpa directa a la afectada.

Consecuencias devastadoras para la víctima

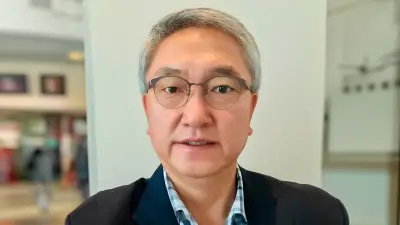

Para Angela Lipps, madre de tres hijos y abuela de cinco nietos, "sus meses de encarcelamiento fueron devastadores", según describió CNN en su reportaje. Los abogados de la mujer declararon a la cadena que "el trauma, la pérdida de libertad y el daño a su reputación no se pueden reparar fácilmente".

El equipo legal agregó que están investigando por qué Lipps permaneció detenida durante tanto tiempo cuando "parece que los registros bancarios exculpatorios estaban fácilmente disponibles" desde el principio. Actualmente, los abogados estudian presentar una demanda por violación de los derechos civiles, aunque aún no la han interpuesto formalmente.

No es un caso aislado

Este incidente no representa la primera vez que el uso de inteligencia artificial en labores policiales genera controversia y conduce a errores graves. El año pasado, la policía armada esposó y registró a un estudiante de secundaria del condado de Baltimore después de que un sistema de seguridad basado en IA señalara la bolsa vacía de Doritos del adolescente como un posible arma de fuego.

Aquél incidente desató fuertes críticas hacia los protocolos de seguridad escolar y generó numerosas peticiones de rendición de cuentas por parte de la comunidad. Estos casos ponen en evidencia los riesgos y limitaciones de confiar ciegamente en tecnologías emergentes sin los debidos controles y supervisiones humanas.

La situación de Angela Lipps destaca los peligros potenciales de implementar sistemas de reconocimiento facial sin mecanismos adecuados de verificación y debido proceso legal. Mientras su equipo legal prepara acciones legales, el caso ha reavivado el debate sobre el equilibrio entre innovación tecnológica y protección de derechos fundamentales en el ámbito de la seguridad pública.